IBL News | Nueva York

Nvidia presentó una plataforma de IA para enseñar Lenguaje de Señas Americano (ASL), la tercera lengua más prevalente en el país después del inglés y el español. El objetivo es romper las barreras de comunicación entre las comunidades sordas y oyentes.

En los Estados Unidos, alrededor de 11 millones de personas son sordas o tienen pérdida auditiva significativa.

Desarrollado en colaboración con la American Society for Deaf Children y la agencia creativa Hello Monday, esta plataforma web interactiva, llamada Signs, apoya el aprendizaje de ASL y el desarrollo de aplicaciones de IA accesibles.

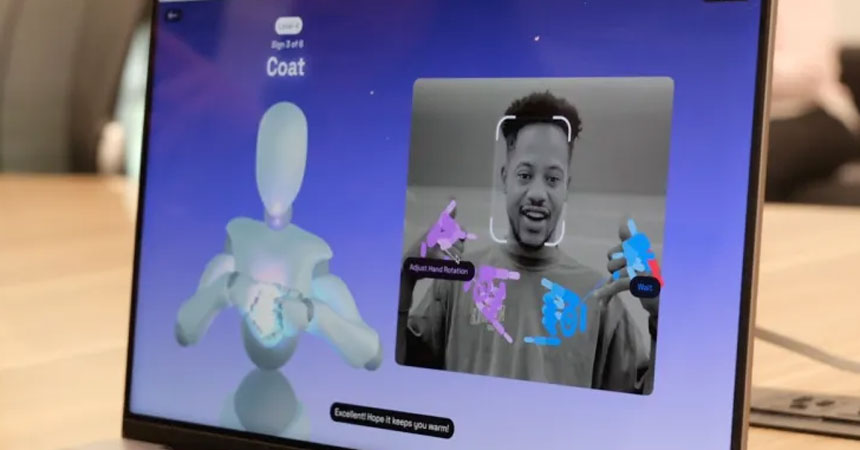

Un avatar en 3D demuestra signos y utiliza una herramienta de IA que analiza imágenes de la cámara web para recibir retroalimentación en tiempo real sobre su manera de firmar.

Los usuarios de cualquier nivel de habilidad pueden contribuir firmando palabras específicas, lo que ayuda a construir un conjunto de videos para ASL.

Nvidia aspira a hacer crecer este conjunto de datos a 400,000 videoclips que representan 1,000 palabras firmadas, con el objetivo de tener un diccionario visual de alta calidad y una herramienta de enseñanza. Usuarios fluidos en ASL e intérpretes participan para garantizar la precisión de cada signo.

Este conjunto de datos, que comienza con un conjunto inicial de 100 signos, se utilizará para desarrollar aún más aplicaciones de IA. Estará disponible para el público como un recurso para construir agentes de IA, aplicaciones digitales y herramientas de videoconferencia.

El conjunto de datos detrás de Signs está planeado para ser lanzado más adelante este año.

Mientras que Signs actualmente se enfoca en los movimientos de manos y posiciones de los dedos para cada signo, el ASL también incorpora expresiones faciales y movimientos de cabeza para transmitir significado. El equipo de Nvidia detrás de Signs está explorando cómo estos señales no manuales pueden ser rastreados e integrados en futuras versiones de la plataforma.

Este equipo también está investigando cómo otros matices, como variaciones regionales y términos coloquiales, pueden ser representados en Signs para enriquecer su base de datos de ASL, y está colaborando con investigadores del Centro de Investigación de Accesibilidad e Inclusión de la Tecnología de la Información de la Rochester Institute of Technology para evaluar y mejorar aún más la experiencia de usuario de la plataforma Signs para usuarios sordos y con discapacidad auditiva.

“Mejorar la accesibilidad de ASL es un esfuerzo continuo,” dijo Anders Jessen, socio fundador de DEPT Hello Monday, que construyó la plataforma web Signs y previamente trabajó con la American Society for Deaf Children en Fingerspelling.xyz. Esta aplicación enseñaba a los usuarios el alfabeto de ASL. “Signs puede cubrir la necesidad de herramientas de IA avanzadas que ayuden a superar las barreras de comunicación entre las comunidades sordas y oyentes.”

• Comience a aprender o contribuir con Signs en signs-ai.com

• Iniciativas fiables de IA de Nvidia.

• Nvidia GTC, 17-21 de marzo en San José, demo en vivo de Signs.