Noticias IBL | Nueva York

OpenAI comenzó a implementar, a través de una lista de espera, para los usuarios de API su modelo GPT-4 más avanzado.

La empresa describió GPT-4 como “un gran modelo multimodal (que acepta entradas de imágenes y texto, y emite salidas de texto) que, si bien es menos capaz que los humanos en muchos escenarios del mundo real, exhibe un desempeño a nivel humano en varios puntos de referencia académicos y profesionales”.

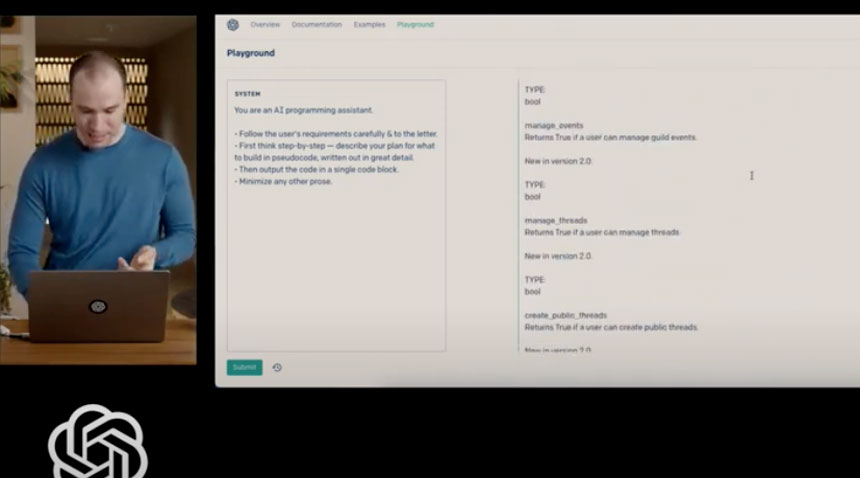

Greg Brockman, presidente y cofundador de OpenAI, mostró GPT-4 y algunas de sus capacidades/limitaciones a través de una transmisión en vivo de 24 minutos en YouTube (video a continuación). Además, una publicación de blog detalla las capacidades y limitaciones del modelo, incluidos los resultados de la evaluación.

“GPT-4 puede resolver problemas difíciles con mayor precisión, gracias a su conocimiento general más amplio y capacidades de razonamiento avanzadas”, dijo la empresa.

“Puede generar, editar e iterar con los usuarios en tareas de escritura técnica y creativa, como componer canciones, escribir guiones o aprender el estilo de escritura de un usuario”.

OpenAI abrió una Lista de espera de API para obtener acceso a la API de GPT-4. Otorgó acceso prioritario a los desarrolladores que contribuyen a las evaluaciones de modelos para OpenAI Evals.

A los usuarios pagos de ChatGPT Plus se les ofreció acceso GPT-4 en chat.openai.com con un límite de uso.

El precio de la API fue el siguiente:

• gpt-4 con una ventana de contexto de 8K (alrededor de 13 páginas de texto) costará 0,03 USD por cada 1K tokens de solicitud y 0,06 USD por cada 1K tokens de finalización.

• gpt-4-32k con una ventana de contexto de 32 000 (alrededor de 52 páginas de texto) costará 0,06 $ por cada 1 000 tokens de solicitud y 0,12 USD por cada 1 K de tokens de finalización.