Noticias IBL | San Francisco

Meta lanzó la semana pasada un nuevo conjunto de datos de referencia de código abierto llamado FACET (Evaluación de la visión por computadora), que está diseñado para evaluar y mejorar la equidad en los modelos de visión de IA.

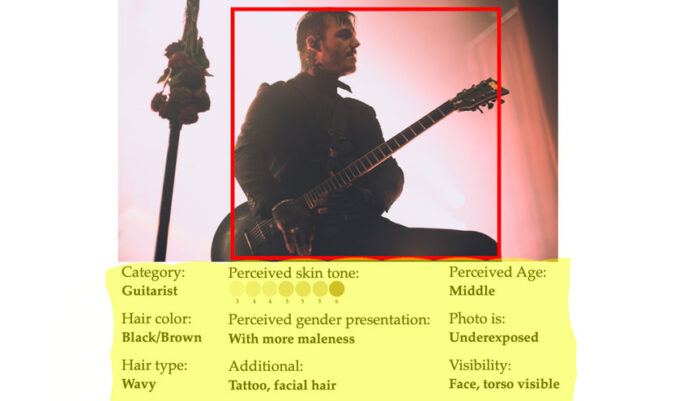

FACET consta de 32.000 imágenes que contienen 50.000 personas etiquetadas por anotadores humanos. Da cuenta de clases relacionadas con ocupaciones y actividades como “jugador de baloncesto” o “médico”, como se muestra en la imagen de arriba.

“Nuestro objetivo es permitir a los investigadores y profesionales realizar evaluaciones comparativas similares para comprender mejor las disparidades presentes en sus propios modelos y monitorear el impacto de las mitigaciones implementadas para abordar las preocupaciones de equidad”, escribió Meta en un blog. correo.

“No está claro si las personas que aparecen en ellas fueron informadas de que las imágenes se utilizarían para este propósito”, explicó TechCrunch.

En un documento técnico, Meta dijo que los anotadores estaban “expertos capacitados” provenientes de “varias regiones geográficas”, incluidas América del Norte (Estados Unidos), América Latina (Colombia), Medio Oriente (Egipto), África (Kenia), Sudeste Asiático (Filipinas) y Asia Oriental (Taiwán).

Además del conjunto de datos en sí, Meta ha puesto a disposición una herramienta de exploración de conjuntos de datos basada en la web.

.