Noticias IBL | Nueva York

El Índice de IA de 2023 [leer completo aquí], compilado por investigadores de la Universidad de Stanford y empresas de IA como Google, Anthropic, McKinsey, LinkedIn y Hugging Face: sugiere que la IA está entrando en una era de control corporativo, en la que los actores de la industria dominan la academia y el gobierno en la implementación y protección de las aplicaciones de IA.

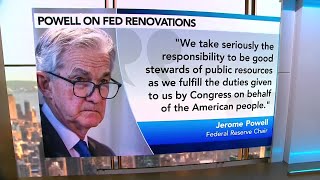

Las decisiones sobre cómo implementar esta tecnología y cómo equilibrar el riesgo y la oportunidad están firmemente en manos de los actores corporativos, como hemos visto en los últimos años con las herramientas de IA, como ChatGPT, Bing y el software de generación de imágenes Midjourney, que se están generalizando. .

El informe, publicado hoy, afirma: “Hasta 2014, los modelos de aprendizaje automático más significativos fueron publicados por la academia. Desde entonces, la industria se ha hecho cargo. En 2022, había 32 modelos de aprendizaje automático importantes producidos por la industria en comparación con solo tres producido por la academia. La construcción de sistemas de IA de última generación requiere cada vez más grandes cantidades de datos, computación y dinero, recursos que los actores de la industria poseen inherentemente en cantidades mayores en comparación con las organizaciones sin fines de lucro y la academia”.

A muchos expertos en el mundo de la IA, mencionado por The Verge, les preocupa que los incentivos del mundo de los negocios también conducirán a resultados peligrosos a medida que las empresas se apresuren a sacar productos y dejen de lado las preocupaciones de seguridad.

A medida que las herramientas de IA se generalizan, aumenta la cantidad de errores y casos de uso malicioso. Dichos incidentes pueden incluir muertes relacionadas con el software de conducción autónoma de Tesla; el uso de deepfakes de audio en estafas corporativas; la creación de desnudos falsos no consentidos; y numerosos casos de arrestos por error causados por un software de reconocimiento facial defectuoso.