Noticias IBL | Nueva York

Los investigadores de Apple presentaron en un artículo nuevos métodos para entrenar LLM multimodal tanto en texto como en imágenes en lo que parece ser un avance significativo para la IA generativa y los futuros productos de Apple.

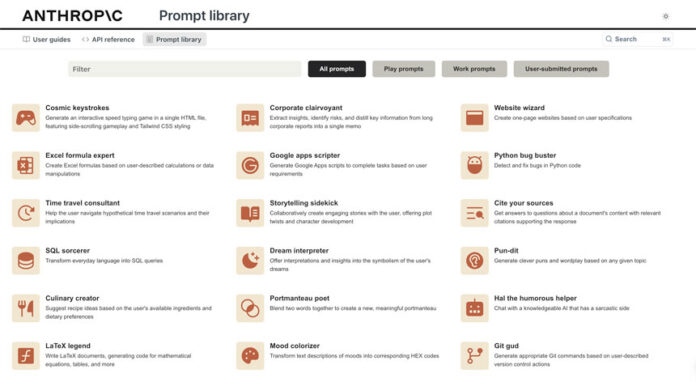

La investigación, publicada este mes, se describió en un artículo titulado “MM1: Methods, Analysis & Perspectivas de la formación previa en LLM multimodal”.

El modelo de parámetros 30B más grande mostró una gran capacidad para aprender de solo un puñado de ejemplos y razonar sobre múltiples imágenes.

Los puntos de referencia de este modelo multimodal compiten con GPT-4V y Gemini Pro.

El modelo se entrenó con una combinación cuidadosamente seleccionada de títulos de imágenes, datos de texto de imagen y datos de solo texto.

Los expertos dicen que el nivel de detalle de Apple es un gran cambio para la marca y representa una gran victoria para la comunidad de código abierto.