Noticias IBL | Nueva York

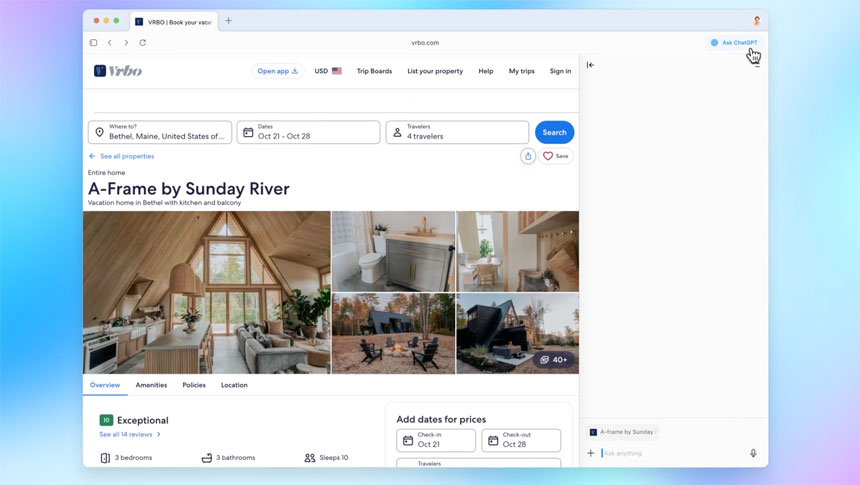

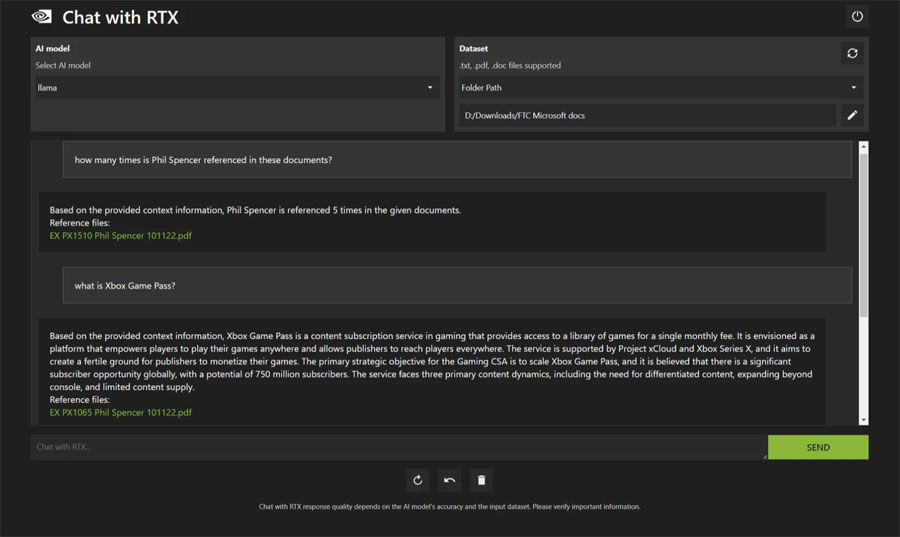

NVIDIA presentó ayer una aplicación de chatbot de demostración personalizada llamada Chat With RTX que se ejecuta localmente en PC con Windows con tecnología RTX y proporciona resultados rápidos y seguros.

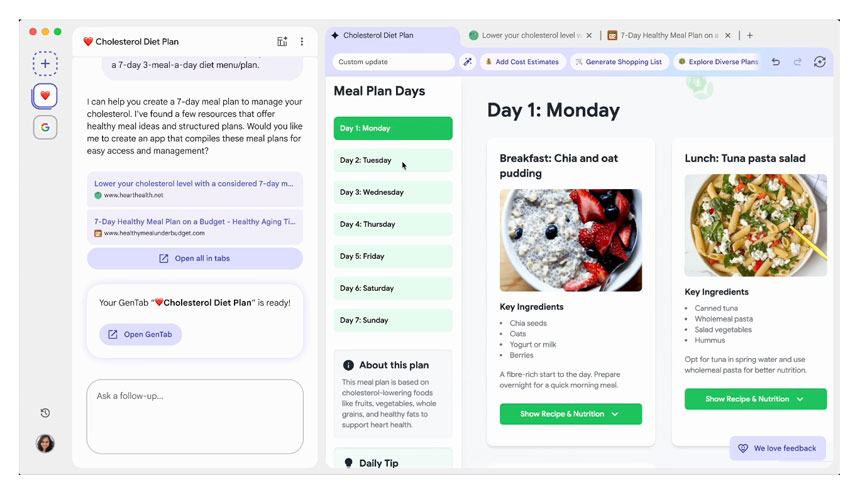

Esta primera versión permite a los usuarios personalizar un LLM conectado a su propio contenido: documentos, notas, vídeos u otros datos. Aprovecha la generación de recuperación aumentada (RAG), TensorRT-LLM y aceleración RTX. para que los usuarios puedan consultar un chatbot personalizado para obtener rápidamente respuestas contextualmente relevantes.

Disponible para descargar, con un instalador de 35 GB, Chat With RTX de NVIDIA requiere Windows 11 y una GPU con GPU NVIDIA GeForce RTX serie 30 o 40 o GPU NVIDIA RTX Ampere o Ada Generation con al menos 8 GB de VRAM.

Con esta aplicación Diseñado para buscar documentos locales y archivos personales, los usuarios pueden alimentarlo con videos de YouTube y sus propios documentos para crear resúmenes y obtener respuestas relevantes basadas en sus propios datos, analizando la colección de documentos y escaneando archivos PDF.

Chat with RTX esencialmente instala un servidor web y una instancia de Python en una PC, que luego aprovecha los modelos Mistral o Llama 2 para consultar los datos. No recuerda el contexto, por lo que las preguntas de seguimiento no pueden basarse en el contexto de una pregunta anterior.

La instalación dura 30 minutos, como The Verge analizado.

Se necesita una hora para instalar los dos modelos de idiomas (Mistral 7B y LLaMA 2) y requirieron 70 GB.

Una vez instalado, se abre una ventana de símbolo del sistema con una sesión activa y el usuario puede realizar consultas a través de una interfaz basada en navegador.

.

🚨 ÚLTIMA HORA: Nvidia acaba de lanzar Chat with RTX, un chatbot de IA que se ejecuta localmente en tu PC.

Puede resumir o buscar documentos en los archivos de su PC e incluso en videos y listas de reproducción de YouTube.

El chatbot se ejecuta localmente, lo que significa que los resultados son rápidos, puedes usarlo sin… pic.twitter.com/je3gzOs45I

— Rowan Cheung (@rowancheung) 13 de febrero de 2024